(相关资料图)

(相关资料图)

大型科技公司在AI 聊天机器人完全成熟之前急于推出它们,感觉有点像狂野的西部。这带来了过多的担忧,其中最重要的是错误信息的传播,但也存在安全和保障问题。为了帮助解决突然迅速出现的高级 AI 聊天机器人,NVIDIA 发布了一个开源解决方案,开发人员可以使用该解决方案来指导生成 AI 应用程序。

它被称为 NeMo Guardrails,旨在确保构建在大型语言模型 (LLM) 之上的 AI 聊天机器人和其他智能应用程序“准确、适当、切合主题且安全”。

“今天发布之际,许多行业都在采用 LLM,这些 AI 应用程序背后的强大引擎。他们正在回答客户的问题,总结冗长的文档,甚至编写软件和加速药物设计。NeMo Guardrails 旨在帮助用户保持这一新类别AI 驱动的应用程序是安全的,”NVIDIA 在博客文章中表示。

AI 聊天机器人和其他相关工具有可能简化编写代码、彻底改变客户服务等任务。然而,它们在目前的状态下远非万无一失。最近的一份报告强调了谷歌的员工如何抨击该公司的 Bard AI 聊天机器人是“病态的说谎者”并且“比无用还糟糕”。

不是专门针对巴德,但它也被发现剽窃了一篇文章,然后声称显示肮脏行为的屏幕截图是假的(它们不是)。

重要的是要记住,这些 AI 聊天机器人,无论是由ChatGPT或 LaMDA 还是其他任何东西提供支持,本质上都是测试版工具。为此,他们中的大多数都带有免责声明。同时,尽管存在一些问题,但这些工具并没有消失。这就是 NVIDIA 的 NeMo Guardrails 发挥作用的地方。

检察官担任法治副校长有了“指挥棒”

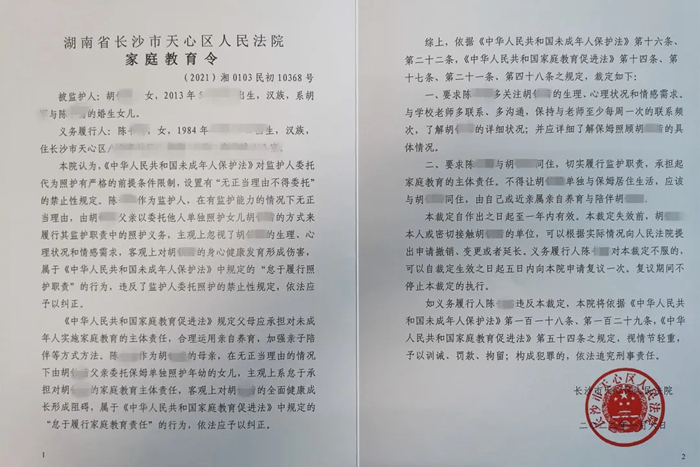

检察官担任法治副校长有了“指挥棒” 全国首份《家庭教育令》来了!督促家长“依法带娃”

全国首份《家庭教育令》来了!督促家长“依法带娃” 俄军装甲车辆将具备隐身能力

俄军装甲车辆将具备隐身能力